على مر السنوات الماضية، أصدر الاتحاد الأوروبي عدة قوانين وتوجيهات تنظم مجالات متعددة مع تضمين قواعد تتعلق بالرقمنة، مثل قانون (CE) رقم 300/2008 الخاصة بأمن الطيران المدني، والقانون (UE) رقم 167/2013 وقانون (UE) رقم 168/2013 اللذين ينظمان سوق المركبات الزراعية والرباعية، إلى جانب قوانين أخرى مثل (UE) 2018/858 التي تتناول مراقبة المركبات ذات المحركات. وقد شملت التوجيهات مجالات متنوعة كتوجيه 2014/90/UE للمعدات البحرية، والتوجيه (UE) 2016/797 حول سلامة أنظمة السكك الحديدية، واللائحة العامة لحماية البيانات (RGPD) لحماية خصوصية الأفراد، فضلاً عن تشريعات أخرى تناولت الأمن السيبراني مثل (UE) 2019/881 والقوانين المرتبطة بحماية المستهلكين.

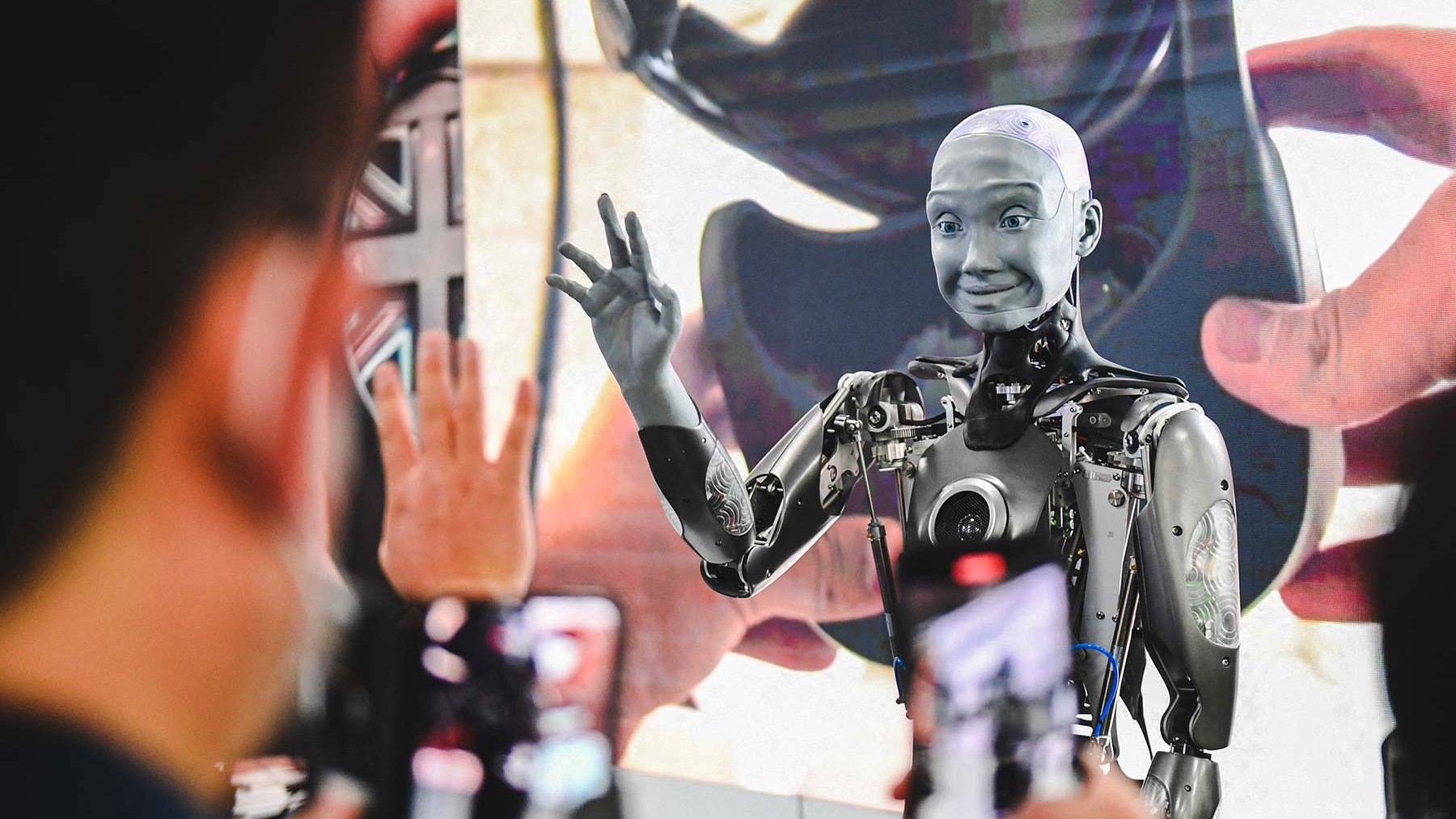

ورغم أن هذه القوانين تناولت الرقمنة بشكل جزئي، إلا أن التشريع الجديد (UE) 2024/1689، الصادر عن البرلمان الأوروبي والمجلس في 13 حزيران (يونيو) 2024، يمثل نقلة نوعية. فهذا التشريع يقدم إطارًا شاملًا لتنظيم الذكاء الاصطناعي بهدف ضمان سلامة الأفراد والمجتمع، وحمايتهم من المخاطر المحتملة، مع تعزيز الابتكار الرقمي المسؤول وضمان الشفافية والمساءلة في استخدام أنظمة الذكاء الاصطناعي عبر دول الاتحاد الأوروبي.

فصول القانون وأهدافه العامة

فمن الناحية الشكلية يتكون القانون الجديد من 13 فصلًا و113 مادة، تغطي جميع الجوانب المتعلقة بالذكاء الاصطناعي. يبدأ بتعريفات دقيقة لأنظمة الذكاء الاصطناعي، ثم ينتقل لتحديد المتطلبات التقنية والقانونية لمزودي الأنظمة، متبوعًا بآليات لمراقبة وضبط الأنظمة بعد إطلاقها في السوق. وموضوعيًا، يهدف القانون إلى تحقيق رهان حماية الأفراد والمجتمعات من المخاطر، مع السعي للحفاظ على التوازن بين الابتكار والحماية. ويتناول القانون قضايا مهمة مثل إدارة المخاطر، متطلبات الشفافية، حوكمة البيانات، وحفظ الوثائق والإبلاغ عن الحوادث، وذلك لتعزيز الشفافية والأمان الاجتماعي.

مميزات القانون ونطاق تطبيقه

يتميز قانون الذكاء الاصطناعي (UE) 2024/1689 بالسبق التشريعي لتوفير إطار قانوني شامل لجميع قطاعات الاقتصاد والأنشطة الاجتماعية، حيث ينص وفقًا للمادة 1 على تعزيز الذكاء الاصطناعي الذي يستحق الثقة ويركز على الإنسان، مع ضمان مستوى عالٍ من حماية الصحة والسلامة والحقوق الأساسية. وبخصوص نطاق تطبيقه فهو يغطي جميع الجهات المعنية بتطوير واستخدام أنظمة الذكاء الاصطناعي داخل الاتحاد الأوروبي وخارجه، بما في ذلك الموردون والمشغلون والمستوردون والموزعون والمصنعون، لضمان الاستخدام الآمن والمسؤول للذكاء الاصطناعي.

توحيد التعريفات التقنية

من مميزات التشريع الأوروبي كذلك توحيد مجموعة من التعريفات التقنية، حيث يقدم القانون تعريفات دقيقة لمايزيد عن 68 مفهوماً رئيسياً مثل الذكاء الاصطناعي الذي يُعرف على أنه أنظمة برمجية تعتمد على خوارزميات قادرة على تحليل البيانات واستنباط الأنماط لاتخاذ القرارات (المادة 3)، وتشمل أنواع أنظمة الذكاء الاصطناعي: الأنظمة منخفضة المخاطر مثل المساعدين الشخصيين، الأنظمة عالية المخاطر التي تؤثر على الحقوق الأساسية، والنماذج العامة للذكاء الاصطناعي كالأنظمة اللغوية الكبيرة.

إطار تنظيمي موحد للذكاء الاصطناعي: التوازن بين الابتكار والحماية

كما خصص القانون قواعد مشتركة للأنظمة عالية المخاطر بهدف حماية الحقوق الأساسية للأفراد والمجتمعات، بحيث تصنف الأنظمة بكونها عالية المخاطر بناءً على تأثيرها المحتمل على الصحة والسلامة والحقوق الأساسية (المادة 51)، وتضمن هذه القواعد تطوير الذكاء الاصطناعي بطرق آمنة ومناسبة، وتراعي المبادئ التوجيهية الأوروبية كـ"الإعلان الأوروبي بشأن الحقوق والمبادئ الرقمية".

إدارة الأنظمة عالية المخاطر

وببعد وقائي واحترازي ينص القانون على ضرورة خضوع الأنظمة عالية المخاطر لتدابير أمان مشددة تشمل مراقبة الأداء وتقييم المخاطر (المادة 53)، خاصة في القطاعات الحساسة كالرعاية الصحية والتعليم والتوظيف، مع إلزامية وجود إشراف بشري على الأنظمة العالية المخاطر (المادة 14).

سلسلة القيمة في أنظمة الذكاء الاصطناعي: توزيع الأدوار والمسؤوليات

ولتحديد الأدوار والمسؤوليات حدد القانون مختلف الأطراف في سلسلة القيمة لأنظمة الذكاء الاصطناعي، بما في ذلك المطورين والموردين والمستوردين والموزعين، مع تأكيد على التزامهم بالمعايير المطلوبة في الجودة والشفافية وإدارة البيانات (المادة 22).

الممارسات المحظورة لحماية الأفراد

تشمل المادة 5 مجموعة من الممارسات المحظورة، لحماية الأفراد من الانتهاكات المحتملة، ومنها منع استغلال الفئات الضعيفة مثل الأطفال وذوي الإعاقة، أو تلك التي تعتمد على تقنيات تمييزية للتقييم الاجتماعي. إذ تُعتبر هذه الأنظمة غير قانونية بسبب قدرتها على انتهاك الخصوصية والتأثير سلبًا على حقوق الإنسان.

آليات الحماية: الشفافية، المساءلة، والتحكم البشري

تضمن المادة 13 تقديم معلومات شفافة عن الأنظمة، بينما تُلزم المادة 17 الموردين بإجراء تقييمات للمخاطر ووضع أنظمة إدارة الجودة. وتؤكد المادة 14 على أهمية الإشراف البشري على الأنظمة.

منظومة الحكامة

تمثل منظومة الحكامة أحد المستجدات والأعمدة الأساسية في هذا القانون، حيث يتولى مكتب الذكاء الاصطناعي المسؤولية الكبرى في الإشراف على تنفيذ القانون، بالتعاون مع اللجنة الأوروبية للذكاء الاصطناعي التي تضم ممثلين عن الدول الأعضاء. كما تلعب الهيئات الوطنية المختصة دورًا محوريًا في مراقبة السوق وضمان الامتثال على المستوى الوطني. وتقوم الهيئات المعتمدة بتقديم الشهادات وضمان أن الأنظمة تستوفي المعايير المطلوبة. إضافة إلى ذلك، يعمل المنتدى الاستشاري والمجموعة العلمية للخبراء المستقلين على تقديم استشارات متخصصة لضمان تكييف التشريعات مع التطورات التقنية.

مستوى الإدانة والعقوبات

يحدد قانون الذكاء الإصطناعي مستوى الإدانة بناءً على مدى خطورة الانتهاكات المرتكبة، فوفقًا للمادة 101، فإن الإدانة تشمل جميع الجهات المعنية في سلسلة القيمة لأنظمة الذكاء الاصطناعي، سواء كانوا مطورين أو مستوردين أو موزعين. يتم تحديد العقوبات بناءً على مبدأ التناسبية، حيث تتناسب العقوبة مع حجم الجريمة ومدى تأثيرها على المجتمع وتأتي لضمان الالتزام الكامل بالمعايير المطلوبة.

كما تُحدد المادة 99 العقوبات المفروضة على مخالفي القواعد التنظيمية، حيث تشمل العقوبات غرامات مالية تصل إلى 35 مليون يورو أو 7 بالمئة من إجمالي الإيرادات العالمية السنوية، أيهما أكبر، كما تنص المادة 100 على فرض عقوبات إضافية على المؤسسات التي تقدم معلومات مضللة للهيئات التنظيمية.

تأثير القانون على مستقبل الذكاء الاصطناعي في أوروبا

في الختام، يمثل هذا القانون الذي سيدخل حيز التنفيذ في غشت 2026 مع مراحل سابقة لتطبيق بعض الأحكام ابتداءً من فبراير 2025، خطوة مهمة نحو تنظيم استخدام الذكاء الاصطناعي داخل الإتحاد الأوربي بهدف تحقيق بيئة قانونية تحمي الأفراد وتدعم الإبتكار، وسيؤهله، في سياق غياب تشريعات شاملة، لجعله فاعلا دوليا في مجال الشريع الرقمي لما تضمنه هذا القانون من تعريفات تقنية وتحديد واضح للمسؤوليات وهيكلة بنيوية لمنظومة الحكامة والتنظيم في سلسلة الرقمي، في انتظار التفكير في تنظيم دولي جديد يعنى بالذكاء الإصطناعي لحماية شاملة من أخطاره واستثمار عادل من فوائده.

التعليقات